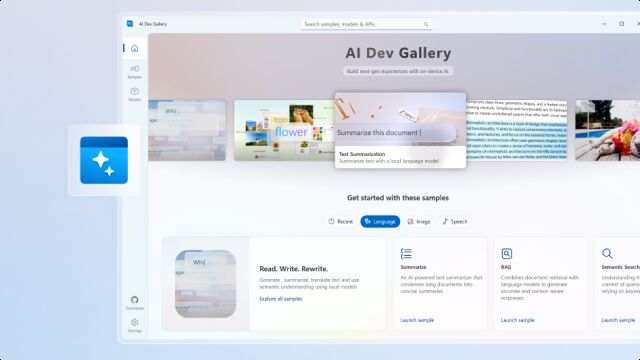

Microsoft Foundry on Windows

A unified, reliable and secure platform supporting the AI developer lifecycle from model selection, fine-tuning, optimizing, and deployment across CPU, GPU, NPU, and cloud.

Phi Silica

Small yet powerful language model to generate text.

Text Recognition (OCR)

Recognize text in images.

Image Super Resolution

Upscale your images using local AI models.

Image Segmentation

Identify specific objects in an image.

Image Description

Generate various types of text descriptions for an image.

Object Erase

Retouch your images and remove unwanted objects.

Customize Windows inbox models with your own data

Use LoRA for Phi Silica to customize the on-device small language model with your own data. Build your vector store and bring semantic and lexical search in your apps using Semantic Search and Knowledge Retrieval.

Microsoft Foundry on Windows integrates Foundry Local, offering developers quick access to ready-to-use open-source models on Windows Silicon. This offers the ability for developers to browse, test, interact and deploy models in their local apps. With the Foundry Local model catalog, we have done the heavy-lifting of optimizing these models across CPUs, GPUs and NPUs, making them ready-to-use.